Imagine la scène. Tu bosses sur un projet ultra-confidentiel. Pour aller plus vite, un de tes développeurs copie-colle 500 lignes de ton code source propriétaire dans la version gratuite de ChatGPT pour débugger une fonction capricieuse. Félicitations, tu viens d’alimenter la base de données publique d’OpenAI avec la propriété intellectuelle de ta boîte. C’est exactement ça, le Shadow AI. Et je te parie une bière que ça se passe en ce moment même sur ton réseau d’entreprise.

Pendant des années, on a chassé le Shadow IT, ces petits logiciels installés en douce par les employés. Mais l’intelligence artificielle générative a complètement changé les règles du jeu. Le Shadow AI n’est pas juste un nouveau buzzword marketing pour te vendre des licences de sécurité hors de prix. C’est une hémorragie silencieuse de tes données les plus critiques.

À retenir :

- Le Shadow AI n’est pas qu’un buzzword : c’est l’usage invisible de ChatGPT, Gemini ou d’API tierces par tes propres équipes pour aller plus vite.

- Bannir l’IA ne sert à rien. Si tu bloques l’accès réseau, tes collaborateurs utiliseront leur smartphone perso sur la 4G. La clé, c’est l’encadrement.

- Les vrais dangers ? Fuite de ton code source ou de données clients dans des modèles publics, violations massives du RGPD et hallucinations intégrées à tes livrables.

Shadow AI : pourquoi c’est infiniment plus toxique que le bon vieux Shadow IT ?

Soyons cash sur la définition : le Shadow AI, c’est quand tes employés utilisent des IA génératives dans ton dos, sans l’approbation de la DSI (Direction des Systèmes d’Information). Ça a l’air inoffensif. Après tout, c’est juste une page web avec un champ de texte, non ? Faux.

La différence cruciale avec le Shadow IT historique se situe au niveau du traitement de la donnée. Quand un employé utilise un compte Dropbox non approuvé (Shadow IT), le fichier est stocké passivement. Si tu fermes le compte, tu récupères le contrôle. Avec une IA non approuvée (Shadow AI), la donnée est ingérée. L’algorithme l’absorbe, s’entraîne avec, l’assimile dans ses poids neuronaux et peut littéralement la recracher demain matin sous forme de réponse à l’un de tes concurrents. Une fois que la donnée a été digérée par un Grand Modèle de Langage (LLM), impossible d’appuyer sur le bouton « supprimer ».

Les coupables classiques dans tes équipes sont toujours les mêmes : la version gratuite de ChatGPT (le cauchemar absolu pour la confidentialité), un abonnement GitHub Copilot personnel branché sur ton IDE d’entreprise, des extensions de navigateur obscures qui promettent de « résumer tes emails », ou encore des modèles open source téléchargés sur Hugging Face et exécutés en local sans aucun scan de sécurité préalable.

| Critère | Shadow IT (Classique) | Shadow AI (Générative) |

|---|---|---|

| Type de menace | Fuite par hébergement externe (stockage passif). | Ingestion active, entraînement non désiré, hallucinations. |

| Traitement de la donnée | La donnée reste « telle quelle » sur un serveur tiers. | La donnée est digérée et peut ressortir chez un tiers. |

| Méthode de détection | Relativement facile (audit de factures, scan d’applications installées). | Très complexe (simple trafic HTTPS vers une API cloud ou extension web). |

Mais pourquoi tes équipes contournent-elles la DSI ?

Avant de crier au scandale et de vouloir virer tout le monde, mets-toi cinq minutes à la place de tes collaborateurs. S’ils contournent la sécurité, ce n’est pas par malveillance. C’est à cause de la pression constante de la productivité. Dans un monde où on demande de faire toujours plus avec moins, l’IA est un super-pouvoir. Elle permet de coder deux fois plus vite, de rédiger un compte-rendu chiant en deux secondes ou d’analyser un fichier Excel géant sans faire de tableau croisé dynamique.

Ensuite, il y a l’accessibilité extrême du truc. Pour installer un vieux logiciel pirate, il fallait des droits administrateur. Aujourd’hui, pas besoin de faire un ticket au support IT. Une simple URL, une création de compte avec l’adresse Gmail perso sur le navigateur du bureau, et l’employé a accès à la puissance de calcul la plus avancée du monde. La friction est de zéro.

Enfin, le vrai problème, c’est souvent la DSI elle-même. Les processus internes sont d’une lenteur affligeante. Quand la validation de sécurité d’un outil officiel d’IA prend 6 à 8 mois pour passer devant tous les comités, la technologie a déjà évolué trois fois. L’employé, lui, a des deadlines à tenir aujourd’hui. Donc il fraude les règles pour faire son job. C’est aussi simple que ça.

Fuites, RGPD et hallucinations : les 3 bombes à retardement sur ton bureau

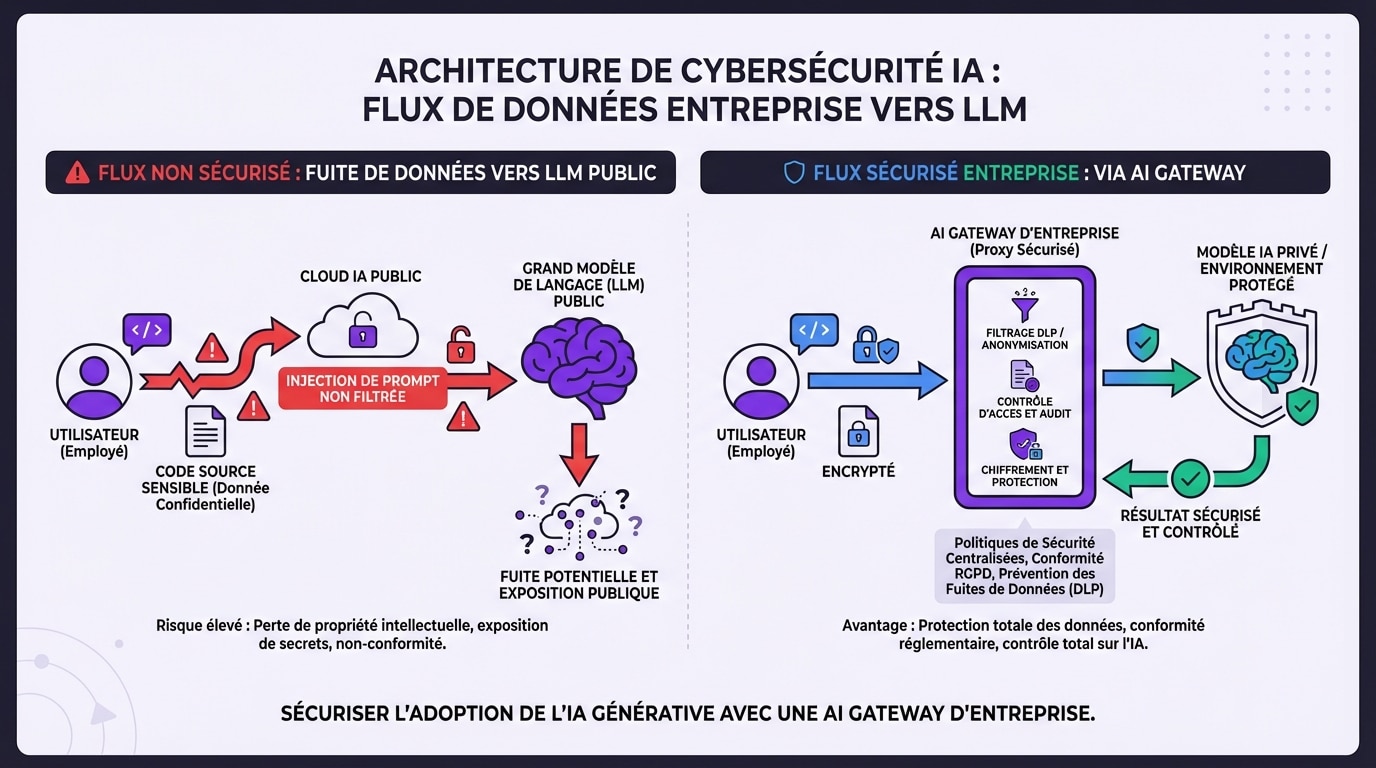

D’un côté, la fuite directe vers un modèle public. De l’autre, un flux sécurisé via une AI Gateway qui filtre et anonymise les données avant traitement.

1️⃣ La première bombe, c’est le drame de la fuite de données confidentielles. On a tous en tête l’exemple catastrophique de Samsung en 2023, où des ingénieurs ont partagé du code sensible et des notes de réunions secrètes avec ChatGPT. Mais ça arrive aussi à plus petite échelle : le responsable RH qui demande à une IA de résumer des fiches de paie pour faire une moyenne, ou le commercial qui injecte la liste des clients VIP pour rédiger un email de prospection personnalisé. La donnée est dehors, et tu n’as aucun log.

🚨 ALERTE ROUGE SÉCURITÉ : Ne sois pas naïf. Lis les Conditions Générales d’Utilisation (CGU) des versions gratuites de ChatGPT, Claude ou Gemini. Elles stipulent explicitement qu’elles s’octroient le droit de réutiliser les prompts (tes questions et les textes que tu colles) des utilisateurs pour entraîner leurs prochains modèles. La gratuité a un prix : tes données commerciales deviennent la matière première de la Silicon Valley.

2️⃣ La deuxième bombe concerne l’élargissement massif de ta surface d’attaque. Utiliser des outils IA non audités, c’est ouvrir la porte à de nouvelles vulnérabilités comme les injections de prompts (où un attaquant cache des instructions malveillantes dans un document que l’IA va lire) ou l’utilisation d’API externes complètement vérolées qui siphonnent ton trafic web en arrière-plan.

3️⃣ La troisième bombe, c’est le cauchemar légal. D’un côté, tu as une non-conformité RGPD immédiate si une donnée personnelle de citoyen européen termine sur un serveur américain non sécurisé. De l’autre, tu as le risque lié aux hallucinations de l’IA (quand le modèle invente des faits avec un aplomb hallucinant). Si tes collaborateurs intègrent ces hallucinations dans du code de production, des contrats juridiques ou des diagnostics clients sans vérifier, c’est ta responsabilité pénale et financière qui est engagée.

Mon plan d’attaque en 5 étapes pour auditer et neutraliser l’IA fantôme

💡 CONSEIL D’EXPERT : La technique de l’Amnistie IA. Lance une période d’un mois dans ta boîte où les employés peuvent déclarer anonymement tous les outils IA qu’ils utilisent, sans risquer le moindre blâme ou sanction RH. L’objectif n’est pas de fliquer, mais de cartographier les vrais besoins du terrain pour leur fournir ensuite les bons outils officiels.

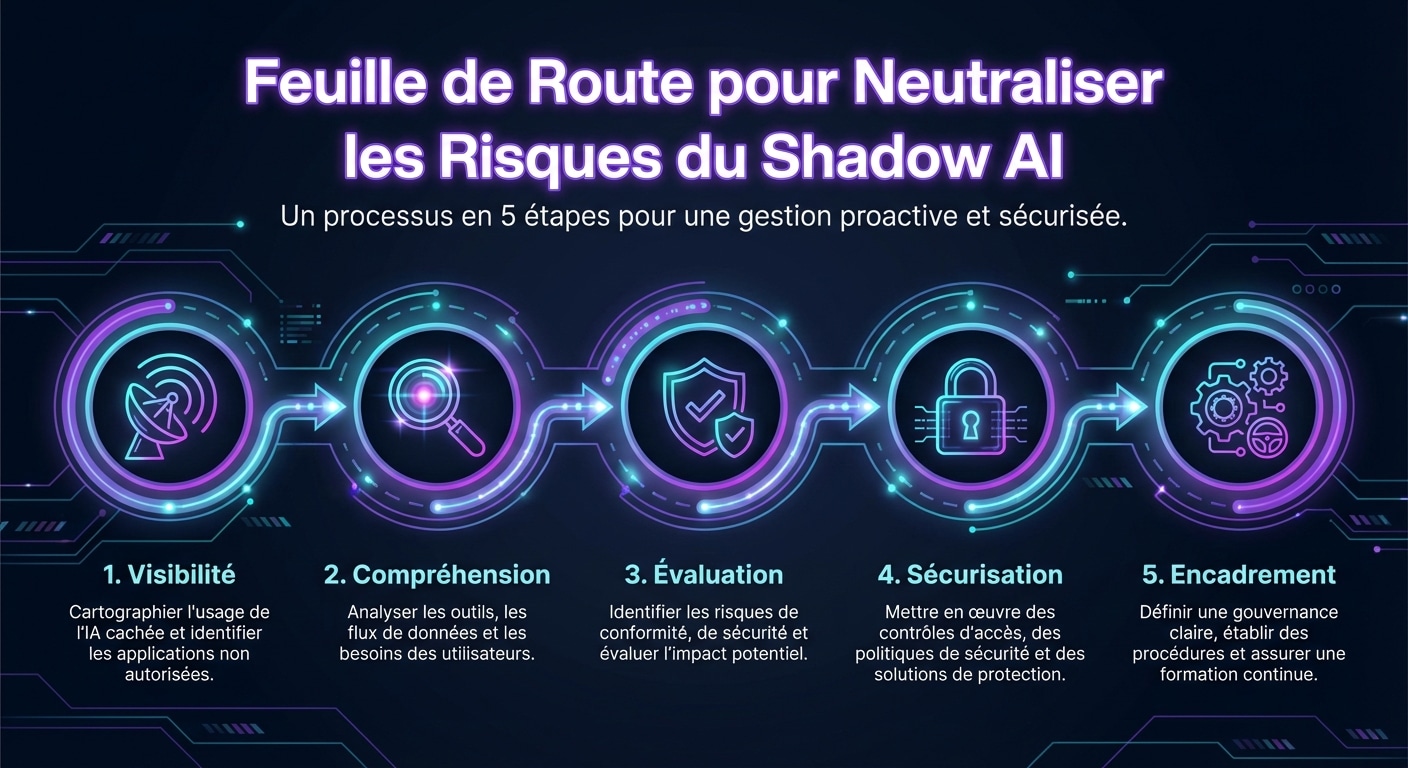

Il est temps d’arrêter de subir et de reprendre le contrôle de ton réseau. Voici une méthode de terrain, pragmatique et actionnable pour assainir la situation.

Créer un cadre de confiance : l’IA encadrée plutôt que bridée

La tech ne résoudra pas tout. Gérer le Shadow AI, c’est avant tout un défi humain et managérial. Il faut impliquer les équipes métiers dès le départ. Instaure un vrai dialogue social autour de la qualité du travail avec l’IA. Qu’est-ce qui est acceptable de déléguer à la machine ? Comment mesure-t-on la performance si l’IA fait la moitié du boulot ? Ces questions doivent être tranchées collectivement, pas juste décidées en vase clos par trois mecs à la DSI.

Ensuite, définis des « garde-fous » clairs. Jette à la poubelle les chartes informatiques de 40 pages écrites dans un jargon juridique imbuvable que personne ne lit. Rédige une charte d’utilisation de l’IA d’une seule page. Sois visuel : crée des zones de données. « Zone Rouge : interdiction absolue de mettre des données clients de la BDD dans une IA publique ». « Zone Verte : feu vert pour reformuler des emails génériques ». Fais simple.

Surtout, forme massivement tes équipes à l’esprit critique. C’est la compétence numéro un du 21e siècle. Tes collaborateurs doivent comprendre qu’un LLM n’est pas un moteur de vérité, mais un moteur de probabilité statistique (un perroquet stochastique, comme on dit dans le milieu). Apprends-leur à douter des résultats, à croiser les sources et à ne jamais exécuter un code généré par l’IA sans l’avoir relu et compris ligne par ligne.

Checklist : Maîtriser le Shadow AI sans bloquer vos équipes

Passez à l'action avec ce plan pour auditer, encadrer et sécuriser l'usage des IA génératives dans votre entreprise.

0 / 8

Les questions qu’on me pose souvent sur le Shadow IA

Est-ce que je peux simplement bloquer ChatGPT au niveau de mon pare-feu pour régler le problème ?

Non, c’est le jeu de la taupe (whack-a-mole). Si tu bloques le domaine principal, tes employés utiliseront des sites miroirs, des plugins intégrés à d’autres logiciels, ou simplement leur forfait mobile. Le blocage réseau ne traite que le symptôme, pas la cause (le besoin de productivité).

Comment savoir si du code a été généré par une IA non approuvée dans mes projets ?

C’est complexe. Il n’existe pas de « détecteur d’IA » fiable à 100%. Cependant, des revues de code rigoureuses, des outils d’analyse statique de sécurité (SAST) et des changements de style de code soudains chez un développeur peuvent mettre la puce à l’oreille. L’obligation de tracer la provenance du code via des commits propres reste ta meilleure défense.

Un outil d’IA payant (abonnement Pro) est-il automatiquement plus sûr pour mes données d’entreprise ?

Généralement, oui, mais vérifie toujours le contrat. Les versions « Enterprise » ou « Team » de la plupart des grands acteurs (OpenAI, Microsoft, Google) stipulent qu’elles n’utilisent pas tes données pour entraîner leurs modèles fondamentaux. En revanche, un abonnement « Plus » grand public payé par la carte bancaire perso d’un de tes employés ne t’offre aucune de ces garanties de confidentialité. Ne confonds pas « payant » et « contrat B2B ».

Et toi, sois franc : as-tu déjà surpris un de tes collègues (ou toi-même) en train de balancer un document confidentiel dans une IA publique pour aller plus vite ? Raconte-moi tes pires découvertes en commentaire !