Jusqu’à hier, déployer un agent IA autonome en production, c’était comme assembler un réacteur nucléaire avec un couteau suisse. Tu y passais des mois à configurer une infrastructure infernale.

Mais Anthropic vient d’annoncer la fin de cette galère absolue le 8 avril avec le lancement de Claude Managed Agents. C’est un game-changer absolu qui transforme l’orchestration complexe d’agents en une simple API.

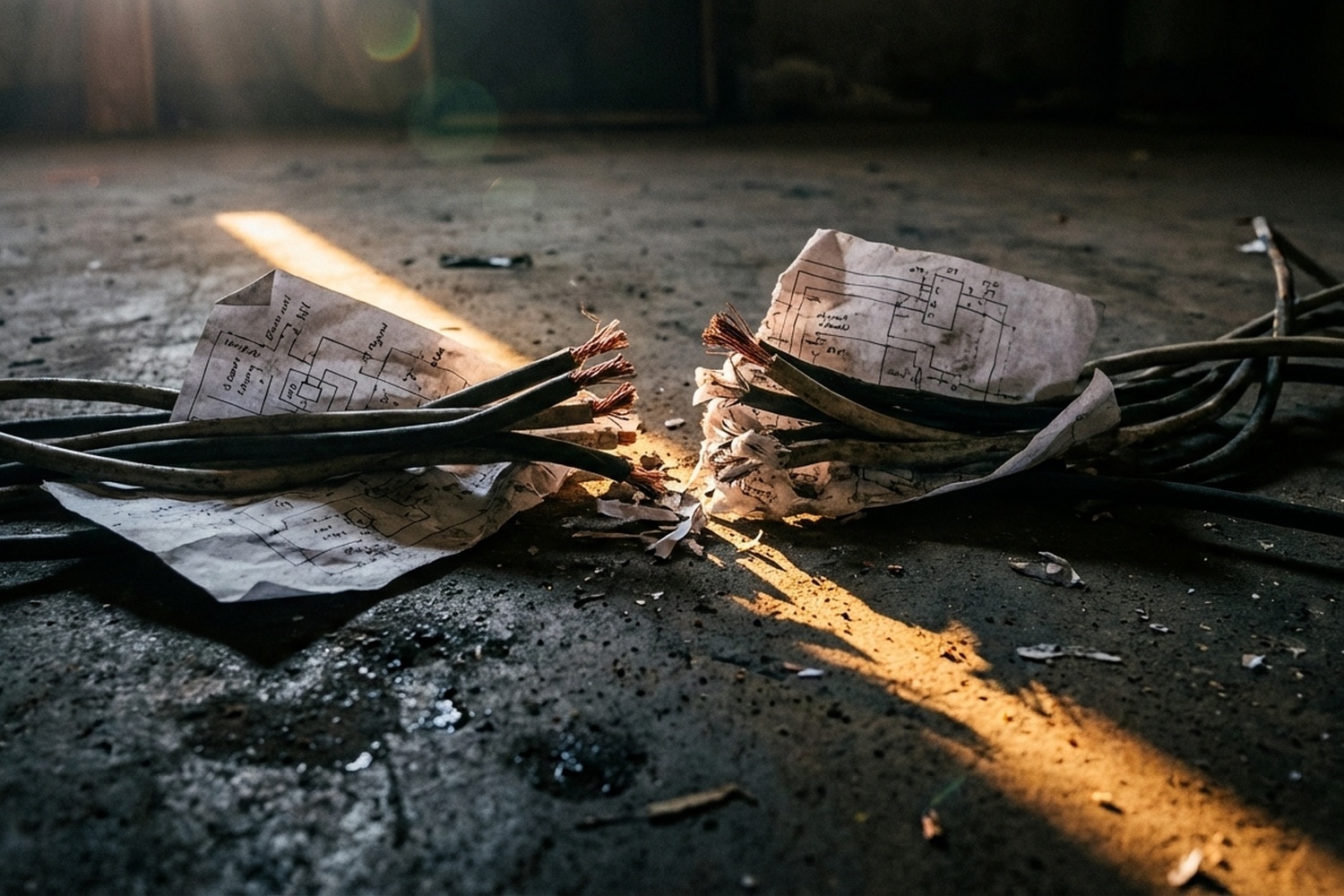

Le cauchemar de la mise en prod (et pourquoi tu y perdais des mois)

Faire tourner un agent en local avec un petit script Python, c’est marrant cinq minutes. C’est le fameux effet « waouh » des démos sur Twitter. Le mettre en prod, c’est l’enfer sur terre.

Avant cette annonce, dès que tu voulais rendre ton agent utile pour tes utilisateurs, tu te prenais un mur de complexité architecturale en pleine face.

Tu devais d’abord construire un sandboxing sécurisé. L’objectif : éviter qu’un LLM qui hallucine ne décide d’exécuter une commande fatale sur ton serveur de base de données.

Ensuite, il y avait l’angoisse de la gestion des états et du checkpointing. Si ton agent plante au bout d’une heure d’analyse de code, tu ne veux surtout pas qu’il recommence à zéro.

Tu te retrouvais à gérer la reprise sur erreur, les limites de rate-limiting des APIs tierces, et une traçabilité faite de logs illisibles. Le constat était amer : tu passais 80% de ton temps sur la plomberie technique et à peine 20% sur la vraie valeur de ton produit.

La méthode Heroku : Anthropic gère la plomberie, tu fournis le cerveau

Claude Managed Agents vient pulvériser ce problème en proposant une suite d’APIs composables. C’est littéralement la méthode Heroku appliquée à l’intelligence artificielle.

Tu ne te préoccupes plus de la boucle d’exécution. Tu définis simplement la tâche à accomplir, les outils autorisés (comme un accès GitHub ou un terminal) et les garde-fous de sécurité.

Tu ne codes plus la boucle d’orchestration LLM, Anthropic te fournit le harnais natif. C’est eux qui se chargent des relances en cas d’erreur et de purger la fenêtre de contexte quand elle déborde.

Leur offre repose sur quatre piliers techniques massifs qui vont drastiquement accélérer tes déploiements :

D’abord, des agents clés en main prêts pour la prod. L’authentification, le sandboxing et l’exécution sécurisée des outils sont gérés en natif par l’infrastructure d’Anthropic.

Ensuite, le support des sessions longues. Ton agent peut tourner en autonomie totale pendant plusieurs heures, même si tu te déconnectes de l’interface.

La fonctionnalité qui m’excite le plus, c’est la coordination multi-agents (actuellement en préversion). Un agent principal peut désormais déléguer des tâches spécifiques à une équipe de sous-agents qui travaillent en parallèle.

Enfin, la gouvernance est implacable. Tu disposes de permissions finement scopées et d’une observabilité totale dans la console Claude pour auditer chaque décision de ton IA.

Regarde à quel point le déploiement est devenu épuré :

POST /v1/agents

{

"objective": "Analyse le ticket Jira #1042, trouve le bug backend et rédige un correctif",

"tools": ["github_api", "bash_terminal", "sentry_logs"],

"guardrails": ["read_only_production", "require_human_pr_review"]

}Sentry, Notion, Asana : ce qu’ils ont déjà automatisé avec ça

Si tu penses que c’est une promesse en l’air, regarde ce que les gros acteurs de la tech ont déjà mis en production avec cette API.

Le cas de Sentry est tout simplement hallucinant pour n’importe quelle équipe de développement. Leur agent lit un rapport d’erreur en prod, fouille dans le codebase, écrit le correctif de lui-même et ouvre la Pull Request sans la moindre intervention humaine.

Chez Notion, ils ont déployé des agents directement dans le workspace des utilisateurs. Ils te génèrent du code ou construisent des slides en temps réel pendant que tu rédiges tes spécifications.

Asana a fait le même pari avec des « AI Teammates ». Ces agents piochent des tâches en attente dans un projet et livrent les résultats attendus comme n’importe quel membre de l’équipe.

Tu peux littéralement répliquer ces cas d’usage dans ta propre boîte dès aujourd’hui.

Imagine des agents de CI/CD vraiment intelligents. Fini les pipelines statiques. L’agent lit les logs du build qui a foiré, comprend l’erreur de syntaxe, applique le patch et relance les tests.

Pense à une revue de code experte et infatigable. Un agent dédié audite tes PR, vérifie tes conventions de nommage et traque les failles de sécurité avant que tes collègues ne soient notifiés.

Ou encore l’onboarding automatique. Tu lâches un agent sur ton vieux monolithe legacy et il génère une documentation complète et à jour pour les nouveaux développeurs de l’équipe.

Honnêtement ? Jette ton code d’orchestration

Parlons du point de blocage habituel : la facture.

Le modèle de tarification est basé sur la consommation. Tu paies le coût classique de tes tokens Claude, plus 0,08 $ par heure de session active.

C’est un tarif absolument dérisoire face au coût journalier d’un ingénieur DevOps qui galère à maintenir des scripts Python instables.

Sauf si tu bosses dans un labo de recherche pour construire le prochain modèle de fondation, ta boîte n’a aucun intérêt à maintenir un framework d’agent maison. Ce n’est plus ton cœur de métier.

Ta vraie valeur ajoutée se trouve dans l’expérience utilisateur que tu proposes et les données métier que tu exploites. L’orchestration des retries ou la gestion de conteneurs de sandboxing, c’est désormais un anti-pattern technique.

Soyons clairs sur l’impact de cette annonce. Anthropic vient de prendre une longueur d’avance colossale sur OpenAI.

Ils ont ciblé avec une précision chirurgicale la vraie douleur du marché : le fossé infranchissable entre un prototype amusant et un produit déployable en entreprise.

Le message est passé. Supprime tes vieilles boucles while, appelle l’API d’Anthropic, et ship ton produit.