Tu as déjà essayé de coder un agent autonome avec Claude Opus ? Je connais la chanson.

Soit tes résultats sont incroyables mais la facture API te donne des sueurs froides, soit tu bidouilles un routage maison vers un modèle plus léger (Haiku) qui finit inévitablement en usine à gaz absolue.

Oublie tout ça, les règles du jeu viennent de changer.

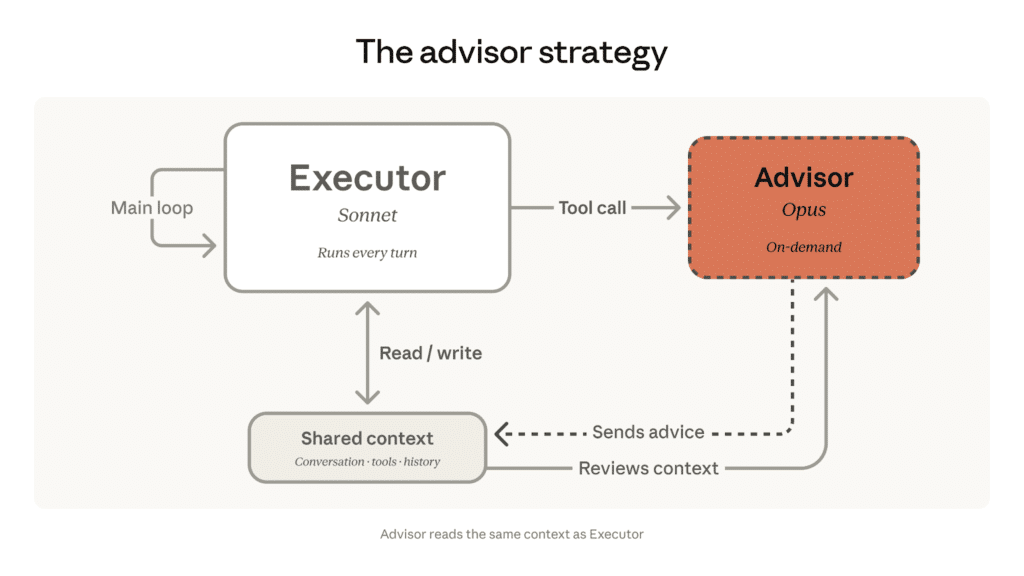

Anthropic vient de sortir « Advisor », et c’est un vrai game-changer technique. Ils ont littéralement codé la dynamique « Développeur Senior / Junior » directement dans leur API, tuant au passage toute la complexité de l’orchestration manuelle.

Le problème des agents actuels : l’orchestration qui coûte un bras

Jusqu’à présent, la création d’agents IA te laissait face à un choix cornélien. Pour avoir un agent fiable, la méthode classique consistait à mettre le modèle le plus intelligent (Opus) aux commandes pour décomposer et distribuer les différentes tâches.

Résultat : tu payais des tokens hors de prix juste pour du simple routage de données.

L’alternative « éco » ? Coder toi-même un système d’orchestration. Un modèle léger (Haiku) gère le flux de base, analyse la demande, et appelle Opus uniquement en cas de besoin. Sur le papier, c’est malin. En réalité, c’est un enfer.

Ça demandait des allers-retours API constants, une latence réseau démultipliée, et une gestion de l’historique du contexte (qui a dit quoi à quel modèle) qui te faisait arracher les cheveux.

Mais Anthropic vient de dégainer une nouvelle architecture inversée brillante.

C’est désormais le « Junior » (Haiku ou Sonnet) qui pilote la tâche de bout en bout. Et ce junior ne va réveiller le « Senior » (Opus) que lorsqu’il bloque sur un problème de logique vraiment complexe.

Sous le capot : comment marche le duo Executor / Advisor ?

Fini le jonglage manuel avec des scripts Python de 500 lignes. L’intégration de cette mécanique est désormais native via l’API Messages (en passant le header expérimental advisor_20260301).

Le transfert de contexte se fait intégralement côté serveur, en une seule et unique requête réseau.

Dans cette architecture, l’Executor (le modèle léger) garde la main sur tes outils externes (les fonctions que tu lui donnes) et sur la réponse finale générée à l’utilisateur. L’Advisor (Opus), lui, agit dans l’ombre. Il lit le contexte, analyse le blocage, et chuchote littéralement le plan d’action à l’oreille de l’Executor, sans jamais interagir directement avec l’utilisateur.

Tu as peur que le modèle s’emballe et appelle Opus en boucle ? Anthropic a prévu le coup avec le paramètre max_uses.

import anthropic

client = anthropic.Anthropic()

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=4096,

extra_headers={"anthropic-beta": "advisor-tool-2026-03-01"},

tools=[

{

"type": "advisor_20260301",

"name": "advisor",

"model": "claude-opus-4-6",

}

],

messages=[

{

"role": "user",

"content": "Résous ce bug critique dans mon code React..."

}

],

)Avec ces quelques lignes, tu viens de mettre en place une orchestration de pointe.

Attention, point à retenir : cette feature est exclusivement réservée aux appels API pour l’instant. Ne la cherche pas dans ton terminal avec l’outil Claude Code, ce n’est pas (encore) disponible, même si ça semble être la prochaine étape logique pour eux.

Des chiffres qui valident l’approche (et ton ROI)

La promesse marketing d’Anthropic est agressive : t’offrir la puissance de raisonnement d’Opus au prix abordable de Sonnet. Et le plus beau, c’est que les benchmarks confirment la théorie.

Si tu as des processus à très haut volume (analyse de logs, traitement de gros datasets), utiliser le combo Haiku (en Executor) avec Opus (en Advisor) permet de réduire tes factures API de 85% par rapport à une utilisation de Sonnet seul.

Mais là où ça devient vraiment intéressant pour nous autres dev, c’est sur la performance brute en ingénierie logicielle.

| Configuration Modèle | Score SWE-bench (Multilingual) | Impact sur le Coût API |

|---|---|---|

| Sonnet (Seul) | Base de référence | 100% du prix |

| Sonnet (Executor) + Opus (Advisor) | + 2,7 points | – 11,9% de réduction |

Tu lis bien le tableau. En ajoutant l’intelligence supérieure d’Opus de manière ciblée, non seulement les performances de code augmentent de 2,7 points, mais la facture globale baisse de près de 12%.

C’est la définition parfaite de l’utilisation chirurgicale de l’intelligence artificielle. On ne paie les tokens premiums que lorsqu’ils sont absolument nécessaires.

Calculateur : Tes économies avec Anthropic Advisor

Estime la réduction immédiate de ta facture API en activant le routage natif Executor/Advisor.

Est-ce la fin des frameworks externes ?

Honnêtement, je pense que cette mise à jour est une véritable masterclass d’ingénierie produit de la part d’Anthropic. En intégrant l’orchestration multi-modèles directement dans l’infrastructure de leur API, ils ont résolu le plus gros frein au déploiement des agents IA en production : le ratio coût/performance.

Le corollaire, c’est que ça rend instantanément des outils externes obsolètes.

Je pense notamment à de nombreux modules de frameworks comme LangChain ou LlamaIndex, qui ont été codés spécifiquement pour gérer ce routage dynamique de LLMs. Pourquoi s’embêter à maintenir une usine à gaz logicielle en local quand l’API gère le cycle de vie, le contexte et le fallback toute seule de son côté, sans latence supplémentaire ?

Si tu construis des agents IA aujourd’hui, tu n’as plus aucune excuse. Tu dois intégrer et tester le paramètre advisor dans tes appels dès ce soir.

Ne gaspille plus tes précieux (et chers) tokens Opus pour lire du JSON basique ou formater une réponse. Garde-les jalousement pour ce qui compte vraiment : l’architecture système de tes projets et les vrais nœuds de logique.